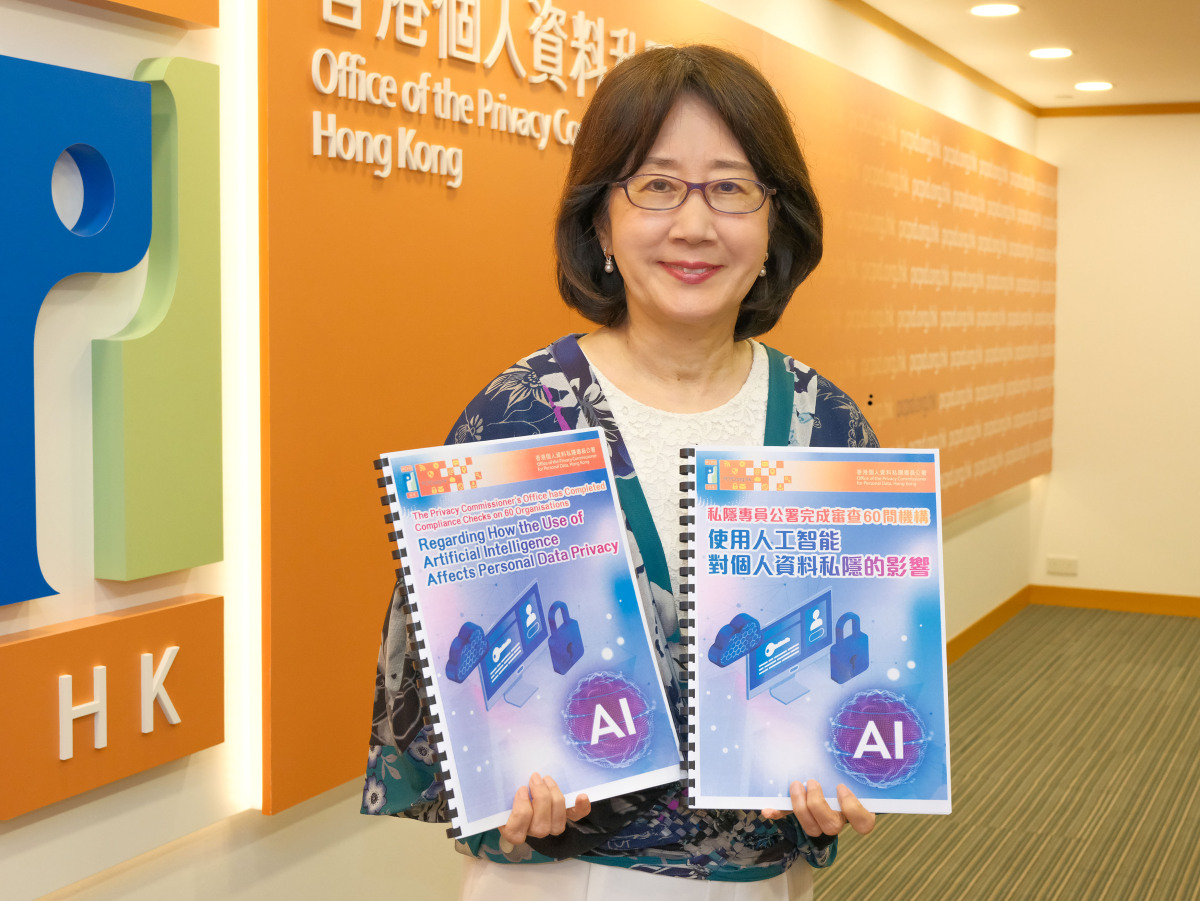

【點新聞報道】隨着人工智能應用日漸普及,越來越多的機構於業務營運中使用人工智能;然而,人工智能所帶來的私隱及安全風險亦不容忽視。個人資料私隱專員公署今日(8日)宣布,完成審查60間機構使用人工智能(AI)的情況,並發表報告。公署在是次循規審查過程中未有發現有違反《個人資料(私隱)條例》(《私隱條例》)相關規定的情況。

公署表示,是次審查涉及60間本地機構,並涵蓋不同行業,包括電訊、銀行及金融、保險、美容、零售、運輸、教育、醫療、公用事業、社會服務及政府部門,以了解它們在使用人工智能時收集、使用及處理個人資料有否遵從《個人資料(私隱)條例》(《私隱條例》)的相關規定。同時,是次審查亦審視了該些機構就公署於2024年發布的《人工智能 (AI):個人資料保障模範框架》(《模範框架》)所提供的建議和最佳行事常規的實施情況,以及對於使用人工智能的管治情況。根據審查結果,其中48間機構在日常營運中使用人工智能,較去年循規審查上升了5%,當中42間機構使用人工智能已超過一年。

私隱專員鍾麗玲表示,審查的機構在透過人工智能系統收集及/或使用個人資料時均採取了相應的保安措施保障數據安全,並在決策過程中採取較高程度的人為監督,以減低人工智能出錯的風險。另外,絕大部分機構均有制定資料外洩事故應變計劃應對突發事故,更有部分機構的應變計劃涵蓋專門針對人工智能相關的資料外洩事故。

公署亦希望透過是次循規審查,向所有開發或使用人工智能的機構提供建議措施,包括制定開發或使用人工智能策略及設立人工智能內部管治架構,並為所有有關人員提供足夠的培訓等。此外,機構亦應制定人工智能事故應變計劃,以監察及應對可能意外發生的事故等。